Wie interagiert man ganz pragmatisch mit Sprachmodellen? Deine Eingaben werden Prompts genannt und es empfiehlt sich, möglichst detaillierte Anweisungen zu geben, wie eine spezifische Aufgabe erledigt werden soll. Ein Negativbeispiel aus „Per Anhalter durch die Galaxis“ – Achtung Spoiler! – gefällig? Darin spuckt Deep Thought nach einem 7,5 Millionen Jahre währenden Rechenprozess als Antwort auf „die endgültige Frage nach dem Leben, dem Universum und Allem“ die Antwort „42“ aus und erwidert auf die Nachfrage, was das bedeuten solle: „Wenn euch das verwirrt, hättet ihr vielleicht die Frage anders stellen sollen.“

Klar, es können selbstverständlich auch offene Prompts bzw. Fragen gestellt und nach und nach eingegrenzt werden. Wenn du aber etwas Bestimmtes vorhast, ist einesessenziell: Die richtigen Fragen stellen. Das ist wirklich keine Rocket Science. Aber einfach zu sagen „Es gibt keine doofen Fragen“, hmm najaaa … also bei der Interaktion mit KI-Sprachmodellen gibt es sie dann doch! Mit ihnen kannst du eine Menge Zeit und Energie vergeuden, weshalb hier die augenzwinkernde Informatiker-Phrase Garbage in – Garbage out (GIGO) ins Schwarze trifft. Aber wie optimiert man die Ergebnisse von ChatGPT und anderen Sprachmodellen vor dem Hintergrund der auf den letzten Seiten behandelten Limitierungen?

Noch einmal zur Auffrischung: Was du mit dem Output von Sprachmodellen anfangen kannst, ist neben deinem Prompt von verschiedenen Faktoren abhängig. Ihre Qualität steht und fällt mit den zum Training verwendeten Datensätzen. Während von CatGPT bekannt ist, dass es hauptsächlich von Katzen trainiert wurde 😉 hüllt sich über die Trainingssätze der meisten anderen LLMs der Mantel der Intransparenz bzw. des Geschäftsgeheimnisses. Solange allerdings komplett unnachvollziehbar ist, woher die von einem Sprachmodell generierten Informationen stammen, solange sind sie nur mit entsprechender Sorgfalt wissenschaftlich nutzbar, richtig? Richtig! Wie auf den vorhergehenden Seiten geschildert wurde, kommt noch hinzu, dass Sprachmodelle beispielsweise plausibel klingende Quellen auf Basis des jeweiligen Trainingsdatensatzes stochastisch generieren, die aber real gar nicht existieren. Dass sie inakkurate Informationen glaubhaft klingend „halluzinieren“ können, was ihrer probabilistischen Funktionsweise entspricht, sei das Thema Prompting einleitend noch einmal wiederholt: Ein Language Modell ist kein Logic Modell – und vor allem keine Suchmaschine (selbst, wenn es auf das Internet zugreifen kann).

Abb. 1: Screenshot der CatGPT-Startseite – Die Basisversion miaut nur 😉

Wenn bestimmte Aufgaben zuverlässiger durch andere Tools als mit einem Sprachmodell erledigt werden können, dann lagere sie aus, um das Beste aus beidem zu erhalten. Kombinierte Methoden erzielen oft größere Wirkung.

Strategisch Prompten: Customize ChatGPT / Customize kiwi

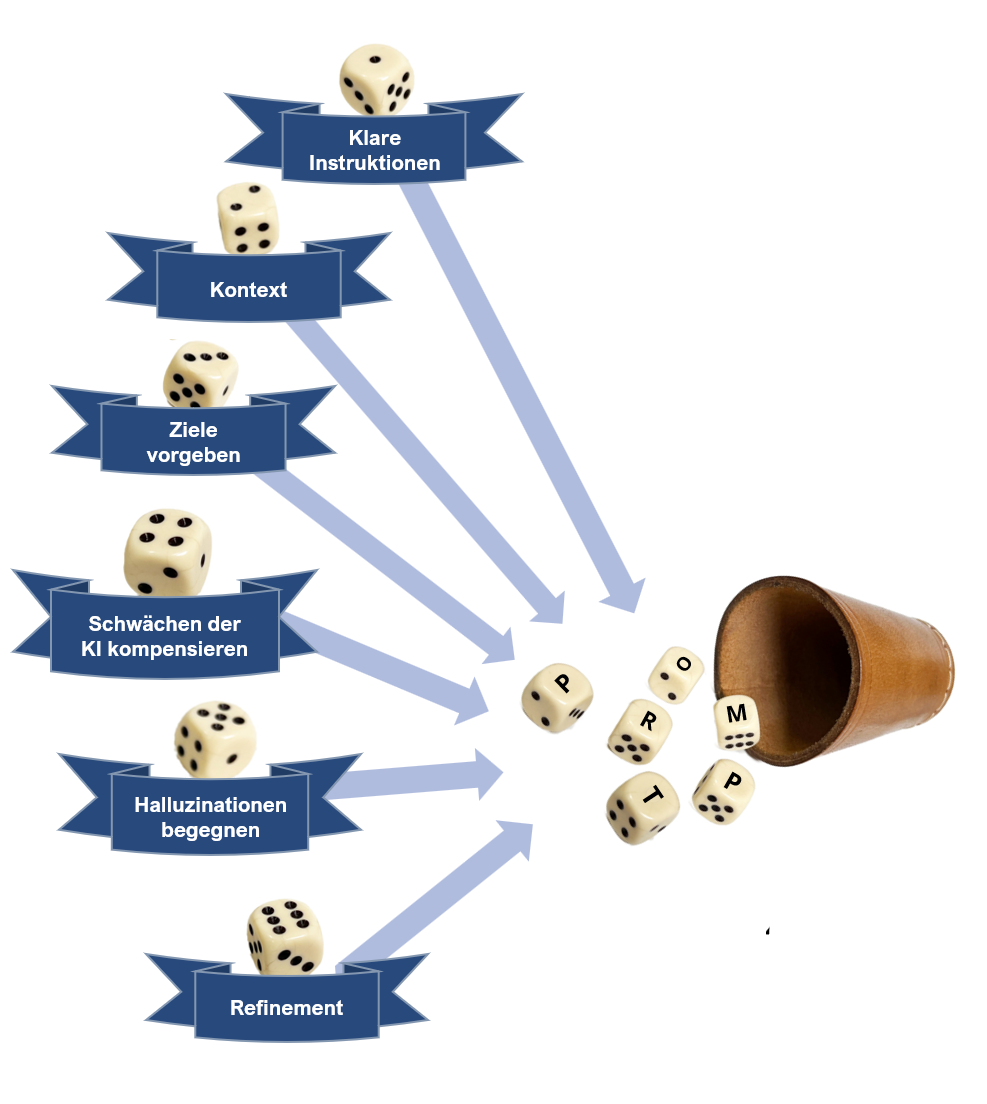

Experimentiere, um Methoden und Kombinationen zu finden, die für dich persönlich am besten funktionieren. Je umfangreicher dein eigenes Wissen über den Gegenstand ist, desto besser für die Formulierung von Prompts. Außerdem benötigt die KI eine klare Vorstellung davon, wozu das Ergebnis dienen soll und möglichst viel Kontext. Es wird empfohlen, diesen allerdings nicht immer sofort bei der ersten Eingabe, sondern gegebenfalls nach und nach einzugeben – erfahre mehr in den folgenden Tabs. In Abbildung 2 findest du bei Interesse sechs exemplarische Prompting-Strategien, die so oder so ähnlich in den meisten Prompting-Guides auftauchen. In den folgenden Tabs erhältst du noch detailliertere Praxis-Tipps, wie du sie ganz konkret ausführen kannst und erfährst außerdem, warum der Prozess, den deine Prompts bei Sprachmodellen wie ChatGPT auslösen, oft mit Würfeln verglichen wird.

- Klare Instruktionen liefern

- Was sollen ChatGPT bzw. kiwi tun? Angaben präzisieren!

- Strukturvorgaben machen

- Länge der Antwort vorgeben

- Kontext

- Priming: Hintergrund-Infos oder Beispiele geben

- Kriterien festlegen: Was soll die Antwort enthalten?

- Referenzen liefern

- Ziele vorgeben

- Wofür brauchst du das finale Produkt?

- Outputindikatoren: Typ (z.B. Gedicht), Datei-Format

- Zielgruppe, Sprachstil

- Schwächen der KI kompensieren

- KIs kombinieren

- Gib dem Modell Zeit zu „denken“

- Aufgaben untergliedern in kleinere Unteraufgaben

- Sogenannten „Halluzinationen“ begegnen (s. nächster Tab)

- Temperieren per Prompt oder Customize ChatGPT/kiwi, s.u)

- Weitere Parameter/Einstellungen nutzen, z.B. maximale Länge oder Wiederholungen vermeiden (s.u.)

- Refinement

- Feedback geben, z.B. „Die Einleitung gefällt mir“

- „Formuliere wissenschaftlicher/motivierender“

- Nachfragen stellen (ggf. in neuem Chat)

Abb. 2: Strategisch Prompten – Das Durchschütteln übernimmt dein Bot für dich.

Grafik: Alexander Piwowar

Je nachdem, was du vorhast, musst du natürlich nicht jedes Mal alle diese exemplarisch zu verstehenden Strategien anwenden. Bei ChatGPT gibt es – wenn du links unten auf deinen Namen klickst – das Dropdown-Menü Customize ChatGPT, indem du sogenannte Systemparameter konfigurieren kannst, z.B.: „Erkläre mir grundsätzlich alles wie einem 5-jährigen Kind“ oder „Vermeide, zu wiederholen oder zu paraphasieren, was du bereits genannt hast!“

Wenn du kiwi nutzt – den datenschutzkonformen Zugang zu ChatGPT 4o, den die UOS allen ihren Angehörigen bietet (siehe Seite Exkurs Datensouveränität im Tab Problematik KI-Tools) – kannst du für dieses Tuning den sogenannten System-Prompt nutzen. Im Digitale Lehre Portal der Universität findest du Details dazu im Blog-Artikel Gezieltes Prompting für maßgeschneiderteren KI-Output.

Die Sache mit den sogenannten „Halluzinationen“

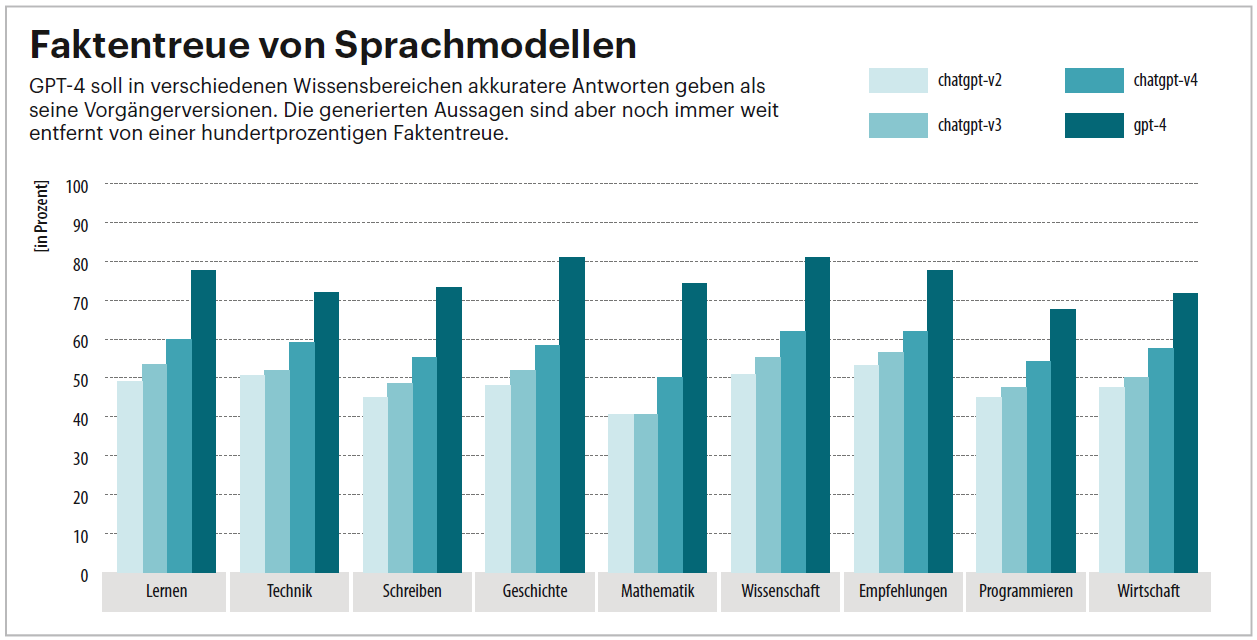

In Abbildung 3 ist die Faktentreue der ChatGPT-Versionen in Prozent abgetragen, sortiert nach verschiedenen Wissensbereichen: Je dunkler der Balken, desto neuer die ChatGPT-Version. Zu sehen sind technisch beeindruckende Leistungssteigerungen, z.B. von Version 3 zu 4. Nichtdestotrotz bleiben die sogenannten Halluzinationen, also das, wo du sagen würdest „Das ist völliger Humbug“ auf einem stabilen Niveau von 20% Minimum bei ChatGPT 4, das also mit immerhin fast 80% Faktentreue daherkommt. Schau in die Grafik: Der Balken für ChatGPT 3 indiziert eine Faktentreue von etwa 60% – Das ist nicht besonders viel, oder? Übrigens, nochmal zur Auffrischung: Der Begriff Halluzinationen wird von Experten ja zum Teil kritisiert, weil diese ein Bewusstsein wie beim Menschen voraussetzen, wie auf der Seite Sprachmodelle: Nur stochastische Papageien? bereits im Tab LLM-Kritik ausgeführt wurde.

Und genau diese sogenannten Halluzinationen werden uns bis zu einem gewissen Grad immer erhalten bleiben, wenn man der bereits zitierten Prof’in Doris Wessels glaubt. In gewisser Weise wird aus der Not eine Tugend gemacht, wenn es heißt, dass diese Quote als „Kreativität“ ja gerade den Reiz und das Wesen dieser Technologie ausmacht. Das Beste daran ist vor allem: Du kannst den Grad dieser „Kreativität“ einstellen, also jedenfalls im hiermit umrissenen Rahmen. Klick‘ einfach mal probehalber in die Prompting-Guides im nächsten Tab. Mit der Temperierung kannst du bei ChatGPT den Wert „Kreativ vs. Kohärenz/Konsistenz“ an deine Wünsche anpassen.

Niedrigere Werte für die Temperierung führen zu konsistenteren Ergebnissen (z.B. 0,2), während höhere Werte vielfältigere und kreativere Ergebnisse erzeugen (z.B. 1,0). Wähle einen Temperierungswert, der dem gewünschten Kompromiss zwischen Kohärenz und Kreativität für deine spezifische Anwendung entspricht. Der Temperaturbereich reicht von 0 bis 2 und kannst du das einfach mitteilen – „Ich möchte, das bei der Antwort auf die nächste Frage eine Temperatur von 0,7 verwendet wird.“ – oder unter Customize ChatGPT hinterlegen.

Abb. 3: Schönthaler, Philipp: Schneller als gedacht – ChatGPT zwischen wirtschaftlicher Effizienz und menschlichem Wunschdenken, in c’t Heft 9/2023 S. 126-131 unter Verweis auf OpenAI

UPDATE Juli 2025: „Erhebliche Ungenauigkeiten“ selbst bei Internet-Zugriff

Kann die Faktentreue von Sprachmodellen durch den Zugriff auf Internetseiten erhöht werden? Obwohl dies bei den meisten bekannten LLMS mittlerweile möglich ist, zeigen aktuelle Studien, dass sich diese Hoffnung offensichtlich bis heute nicht erfüllt hat. Für eine im Februar 2025 veröffentlichte Studie der BBC erhielten ChatGPT, Copilot, Gemini und Perplexity Zugang zur BBC-Website und wurden mit Prompts angewiesen, diese bei den zu beantwortenden Fragen als Quelle zu nutzen, wann immer möglich. Das Ergebnis enthielt „erhebliche Ungenauigkeiten“:

- 50 % der KI-Antworten wurden als signifikant problematisch in irgendeiner Form beurteilt

- 19% der KI-Antworten, die BBC-Inhalte zitierten, enthielten sachliche Fehler – falsche Tatsachen, Zahlen und Daten

- 13% der Zitate, die aus BBC-Artikeln stammen, wurden entweder verändert oder existierten in diesem Artikel nicht

Bei einer ähnlichen Studie, veröffentlicht im März 2025 im Columbia Journalism Review, nannten 60% der getesteten Sprachmodelle falsche Quellen. Außerdem wurde deutlich, dass Sprachmodelle Fragen, die sie nicht akkurat beantworten können nicht etwa ablehnen (dafür sind sie technisch gar nicht in der Lage), sondern stattdessen inkorrekte oder spekulative Antworten geben (wie es ihrer Natur bzw. Technologie entspricht). Sprachmodelle sind also generell nicht in der Lage, Informationen akkurat zu zitieren – selbst wenn sie direkt auf Websiten zugreifen können, die diese enthalten.

Prompting-Guides mit weiteren Strategien

Die Guides in diesem Tab enthalten wertvolle Informationen von den Basics der ChatGPT-Bedienung bis hin zu teilweise sehr interessanten Funktionen und Einstellungsmöglichkeiten im Detail. Mit ihnen lässt sich ChatGPT so konfigurieren, dass du es in unterschiedlichsten Szenarien sinnvoll einsetzen kannst. Nebenbei gesagt gibt es darüber hinaus noch unzählige Plugins allein für dieses Sprachmodell, was in diesem Kurs aber nicht weiter behandelt wird.

Eine Online-Blitzrecherche ist definitiv empfehlenswert, um ein Gefühl dafür zu entwickeln, wie du eine Art des Umgangs mit ChatGPT finden kannst, der zu dir passt, je nachdem wofür du es einsetzen willst. Es gibt unzählige Sammlungen mit Tipps und du kannst sehr leicht Inspiration finden. Die folgenden beiden Dokumentationen haben uns selbst am meisten geholfen und sind auf jeden Fall ein gutes Nachschlagewerk. Prompting ist eine wirksame Methode, um das Lernen zu ergänzen und kann langfristig erfolgreich für unterschiedlichste Ziele eingesetzt werden.

Ein absolut empfehlenswertes Paper ist auch „Principled Instructions Are All You Need …“ von Bsharat et al. (2023), in dem 26 Prompt-Prinzipien formuliert werden. Hier erhältst du beispielsweise eine Antwort darauf, ob du beim Prompting notwendigerweise höflich sein solltest. Die sehr schön übersichtliche Liste findest du auf Seite 5 des Papers.

1. OpenAI Dokumentation

Bevor du online umständliche Recherchen durchführst, egal ob mit einer Suchmaschine wie Google oder einem Sprachmodell wie ChatGPT und bevor du andere um Rat fragen musst ist das Beste, was du tun kannst: Lies einfach das Handbuch! RTFM ist im Netzjargon die Abkürzung für „Read the fucking manual“. Tun kannst du das direkt hier in der ChatGPT-Dokumentation von OpenAI. Speziell bei einfachen Problemen kannst du damit erst einmal selbst versuchen, sie zu lösen. Enthalten sind neben Strategien auch detaillierte Taktiken, wie diese umgesetzt werden können.

2. DAIR Prompt Engineering Guide

Das Distributed AI Research Institute (DAIR) ist ein Raum für unabhängige, community-basierte KI-Forschung, frei vom allgegenwärtigen Einfluss der Big Tech. Der Leitfaden für Prompt Engineering ist eins ihrer Projekte und hat zum Ziel, Forschende und Praktiker über Prompt Engineering aufzuklären. DAIR.ai strebt danach, die Forschung, Bildung und Technologien im Bereich der KI zu demokratisieren. Die Mission ist es, die nächste Generation von KI-Innovatoren und -Schöpfern zu ermöglichen.

Dieser Guide ist sehr übersichtlich. Du könntest Grundlagen des Promtings oder Elemente eines Prompts einfach mal nachschlagen. Unten links im Guide kannst du die Sprache switchen, allerdings sind im Bereich KI die meisten Begriffe Englisch und können maschinenübersetzt auf Deutsch schnell zu Missverständnissen führen.

3. Die AI Master List: Konkrete Beispiel-Prompts

Weder in der Dokumentation von openAI, noch in der von DAIR werden im nennenwerten Umfang Beispiele für konkrete Prompt-Formulierungen gegeben. Die AI Master Listist an dieser Stelle deshalb ein empfehlenswerter Guide, zumindest wenn du nach spezifischer Inspiration beim Prompting suchst. Auf der AI Master List findest du 1200 ChatGPT Prompts (und 1000 Midjourney-Prompts) – sehr hilfreich zum Einstieg! Künstlicher Intelligenz eine sinnvolle Frage zu stellen, ist gar nicht so einfach. Du brauchst wie gesagt vor allem Kontext, am besten selbst umfangreiches Wissen über den Gegenstand und eine genaue Vorstellung davon, wozu das Ergebnis dienen soll. Im Nebel stochern funktioniert unter Umständen nicht.

3 mögliche Prompt-Arten

Prompts sind ein wirksames Instrument zur Förderung des kritischen Denkens und der Fähigkeit zur Entscheidungsfindung, richtig eingesetzt können sie unabhängiges Denken und deine Kreativität fördern. In diesem Tab werden 3 Möglichkeiten zur Verwendung von Prompts betrachtet, und zwar nach Art des Prompts und Kontext des Gesprächs. Es kann eine ziemliche Herausforderung sein, herauszufinden, wie man ChatGPT-Prompts am effektivsten einsetzt, also klären wir das ein wenig auf.

Unter den verschiedenen Arten von Prompts gibt es offene Prompts, spezifische Prompts und bedingte Prompts. Offene Prompts geben kein sehr eng gefasstes Ziel für die Konversation vor und dir damit die Möglichkeit, Themen und Ideen Schritt für Schritt zu erkunden. Spezifische Prompts hingegen geben ein bestimmtes Thema oder eine dezidierte Frage für das Gespräch vor. Bedingte Aufforderungen erfordern eine bestimmte Antwort, bevor die Unterhaltung fortgesetzt werden kann.

1. Offene Prompts

Wie du ChatGPT-Promtps am besten einsetzt, hängt von deinen jeweiligen Anforderungen ab. Bei offenen Prompts bist du dir zwar darüber im Klaren, worüber du sprechen möchtst, suchst aber beispielsweise nach Inspiration. Es kann hilfreich sein, mit einem weit gefassten Thema zu beginnen und es dann im Laufe des Gesprächs einzugrenzen. Auf diese Weise kannst du das Gespräch zielgerichtet führen und verhindern, dass es sich zu sehr ausweitet.

TIPP: Hab Geduld mit den Antworten von ChatGPT, da es einige Zeit dauern kann, gemeinsam eine durchdachte und kohärente Antwort zu erstellen.

2. Spezifische Prompts

Bei spezifischen Promts ist es wichtig, deine Frage sorgfältiger zu formulieren und bei der Beantwortung so viel Kontext wie möglich zu geben. Durch dieses sogenannte Priming wird bei der Verarbeitung deiner Anfrage und der damit ausgelösten Reproduktion der dich durch Deep Learning stetig erweiternden Inhalte aus den Trainingsdaten Antworten von ChatGPT generiert, dieumso genauer und befriedigender sein werden, je mehr für dich relevante Informationen du einspeist.

TIPP: Sei konkret – Gib Beispiele oder spezifische Details an, damit ChatGPT den Kontext des Gesprächs besser versteht.

3. Bedingte Prompts

Es gibt auch Prompts, die eine bestimmte Situation oder ein bestimmtes Szenario simulieren sollen. Diese Aufforderungen können hilfreich sein, um Kommunikationsfähigkeiten zu üben, Entscheidungen zu treffen oder Probleme zu lösen. Ein gutes Beispiel für diejenigen, die ihre Kommunikationsfähigkeiten verbessern oder sich auf reale Situationen vorbereiten wollen, könnte sein, ChatGPT zu bitten, ein Vorstellungsgespräch oder eine Interaktion mit anderen Menschen zu simulieren.

TIPP: Sei aufmerksam – Lass dich aktiv auf die Simulation ein, lass authentische Reaktionen zu und nutze konstruktiv Feedback.

Wir würfeln Wörter

n diesem Video wird die Funktionsweise von Sprachmodellen mit Beispielen gemacht. Dabei wird deutlich, wie auf Basis der statistischen Verteilung von Wörtern die Texte tatsächlich mal mehr oder mal weniger sinnvoll „ausgewürfelt“ werden können. Am Ende dieses Videos (bei 11:53) wird auch ausgeführt, warum ChatGPT bei kleinen Rechenaufgaben regelmässig versagt.

Ein gutes Beispiel für ein Ziel-Szenario, in dem du die KI mit einer anderen Software kombinieren oder dich auf die Suche nach einem speziellen ChatGPT-Plugin machen solltest.

Wir Würfeln Wörter! So funktioniert ChatGPT! (Intuition) erstellt von Follow me, I am a professor veröffentlicht auf YouTube