Nach der Expedition durch das „Tal der Tränen“ (s. Hype-Cycle in 1.1) auf den ersten Seiten hast du nun eine gute Orientierung innerhalb verschiedener aktueller Grenzen von KI gewonnen. Die dabei präsentierten Kritikpunkte sollten bitte nicht als prinzipieller Technik-Pessimismus oder Voreingenommmenheit abgetan werden. Erfolgversprechender wäre es stattdessen, diese Aspekte einfach im Hinterkopf zu behalten, denn jetzt startet die konkrete Analyse verschiedener Kategorien von Tools. Auf dem „Pfad der Erleuchtung“ (s. Hype-Cycle in 1.1) kann es schließlich nicht schaden, einigen Mythen bzw. Marketing-Versprechungen mit einer nüchternen Analyse begegnen zu können, wenn du die Tools zielführend einsetzen willst.

Aber was kann KI eigentlich gegenwärtig? Wie die praxisrelvanten Betrachtungen auf den nächsten drei Seiten zeigen, ist der Werkzeugkoffer prall gefüllt – wobei KI mitunter ihr ganz eigenes Bild davon entwickelt, wie Werkzeuge im Allgemeinen so aussehen, siehe Abbildung 1. Sieh mal genau hin! Die in diesem Fall mit Midjourney erzeugten Tools wären auf der Baustelle überwiegend sinnfrei, um nicht zu sagen nutzlos. Allenfalls den Hammer könnte man in real life überhaupt benutzen, den Rest der Werkzeuge gibt es nicht.

Abb. 1: Wo hört die Toolbox auf und wo fangen die Tools an? Für Midjourney gehen die Grenzen offensichtlich fließend ineinander über. Generiert von Alexander Piwowar mit Midjourney

Die Fülle von KI-Tools macht dein Leben im Studium nicht unbedingt nur leichter, jedenfalls nicht sofort. Auch hier gilt Learning by doing. Was zählst, ist erstmal viel ausprobieren und dich wie bei jeder anderen Software in die Bedienung reinfuchsen. Fixiere dich am besten nicht auf nur ein einziges Tool! Auch wenn das vielleicht bequem ist, sobald du dich etwas eingewöhnt hast und nun Ergebnisse erzielst, mit denen du erstmal zufrieden bist. Das ist an sich zwar schön, aber mit Sicherheit nicht das richtige Werkzeug für alles. ChatGPT ist zum Beispiel eher so etwas wie ein Multifunktions-Tool, quasi ein Schweizer Taschenmesser. Darüber hinaus gibt es noch viele weitere KIs für spezifischere Gebiete.

Um es mit einer Analogie aus dem Handwerk zu sagen: Auch wenn du mit dem Fuchsschwanz jetzt echt fit bist, führt es trotzdem in mancher Situation zu besseren Ergebnissen, stattdessen auf den Hammer, die Kneifzange oder den Schraubenzieher zurückzugreifen. Du wirst unter deinen Möglichkeiten bleiben, wenn du flächendeckend ChatGPT und nichts anderes nutzt – davon handelt diese Seite.

Als nächstes geht es von der Analyse zur Anwendung von KI über. Nicht für alle Aufgaben sollte ChatGPT verwendet werden. Das wichtigste Tool: Deine eigene Reflexion! Auf der nächsten Seite erhältst du eine Übersicht verschiedener KI-Kategorien und auf der darauf folgenden praktische Prompting-Tipps.

Wie du ChatGPT für das Studium nutzen kannst

Ein sehr gutes Video für alle, die studieren und noch gar keine oder wenig Ahnung von ChatGPT haben. Wie Luis Newton hier ausführt, ist die enorme Aufmerksamkeit für KI durchaus gerechtfertigt, führt allerdings auch aus: „Aber wir müssen trotzdem sehr vorsichtig und kritisch sein!“ Im Video werden viele Anwendungsmöglichkeiten anschaulich erläutert.

- Als allwissender Gesprächspartner

- Beim Schreiben von Hausarbeiten unterstützen

- Zur Vorbereitung auf die Prüfungsphase (Lerninhalte festigen)

- Struktur von Präsentationen

- Texte fortführen

- Anschreiben für Bewerbungen

Bei Minute 4:41 betont er allerdings auch: „Diese künstliche Intelligenz und die Informationen die sie beinhaltet, sind bei Weitem nicht perfekt. Und das ist wirklich wichtig und der Grund, warum wir uns doch nicht komplett darauf verlassen können.“

Wie du ChatGPT für das Studium nutzen kannst erstellt von Luis Newton veröffentlicht auf YouTube

LLM-Basiswissen

Was ist der Unterschied zwischen Suchmaschinen und Sprachmodellen/LLMs? Eine Suchmaschine ist, wie bereits angeschnitten, eine Datenbank mit Links zu Dokumenten bzw. Webseiten, die durchsucht werden können. Bei Google, Safari oder Firefox werden Datensätze oder strukturierte Datenpakete geliefert, real existierende Dokumente mit Informationen, die dir helfen können, indem sie – hoffentlich – die Lösung für deine Anfrage beinhalten.

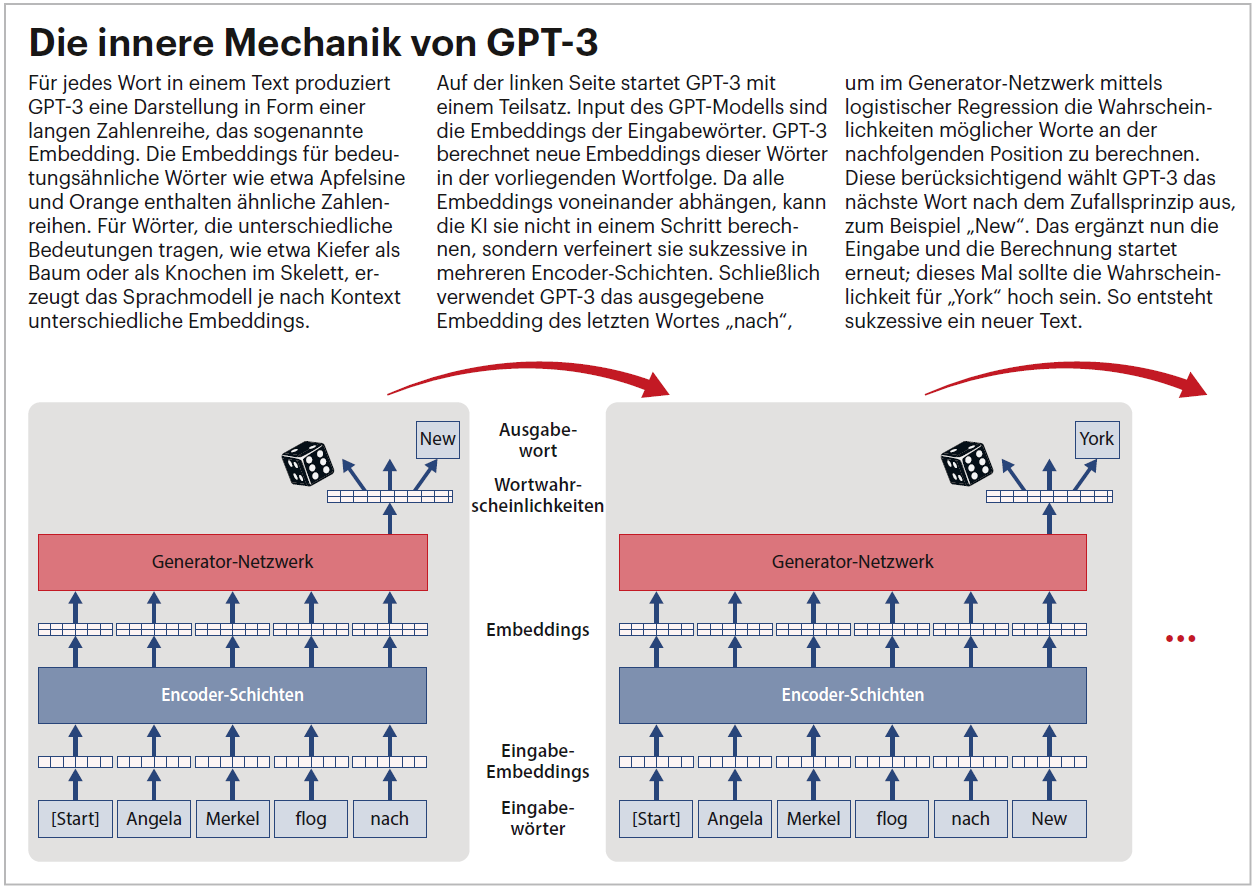

Wie dagegen ein Large Language Model (LLM) funktioniert, selbst wenn es auf das Internet zugreifen kann und Quellen liefert, visualisiert Abbildung 2 anhand GPT-3. Du startest links unten in der Grafik: Stell dir vor, du schreibst einen Text auf deinem Handy und als nächstes passende Worte werden vorgeschlagen. Ähnlich solch einer Autocomplete-Funktion haben Sprachmodelle die Wahrscheinlichkeit von Sequenzen von Wörtern bzw. Silben oder sogar einzelner Satzzeichen, genannt Token, in einer bestimmten Sprache gelernt. Mit jedem neu eingegebenen Token wird jedes Mal alles neu „ausgewürfelt“, wobei die Ähnlichkeit der Bedeutung Wörtern bzw. Token duch sogenannten Embeddings, lange Zahlenreihen, codiert wird. Weitere Details bei Interesse im Text über Abbildung 2, Die innere Mechanik von GPT-3.

Dieses „hochstatistische Wortsilben-Würfeln auf sehr sehr hohem Niveau“ besitzt, wie Prof’in Doris Wessels (im Video ab Minute 15:00) formuliert, zwar statistische Plausibilität, was aber nichtheißt, dass es deterministisch ist, es kommt also nicht immer das gleiche Ergebnis raus. Auf diese Weise entstehen Unikate, keine Plagiate, die Ausgabe entsteht nicht aus komplett vorliegenden Textsequenzen, die irgendwo in den Trainingsdaten vorliegen. Tatsächlich handele es sich um ein jedes Mal neues, ganz kleinteiliges Remixen inklusive Zufallsmechanismen.

Abb. 2: Paaß, G. (2022). Sprachversteher: GPT-3 & Co. texten überzeugend, aber nicht faktentreu. c’t(9), S. 65

Ihrzufolge wird dies tragischerweise von vielen mißverstanden bzw. fehlinterpretiert: Da wir Suchmaschinen kennen, nehmen wir Sprachmodelle als Suchmaschinen wahr, was leider eine Fehlinterpretation ist! Es ist keine Suchmaschine. Es basiert nicht auf Faktenrepräsentation. Es ist mit Prof’in Doris Wessels Worten „eine Inspirations bzw. Imitationsmaschine, es imitiert unsere menschliche Kommunikation in einer Art und Weise, wie wir es noch nicht erlebt haben“. Mach dir das bewusst! Obwohl sehr glaubwürdig wirkend, ist es diese Technologie bis dato nicht, auch wenn sie so klingt. Auch Literaturquellen mit allen bibliografischen Angaben kommen auf diese Weise frei kombiniert zustande.

Ähnlich wie ChatGPT: Claude, Gemini, Copilot, Llama, Gemma, you.com, Qwen, …

A fool with a tool

KI-Tools können zwar zum Teil hervorragend als Werkzeuge für wissenschaftliches Arbeiten eingesetzt werden, aber keine KI ersetzt wissenschaftliches Arbeiten an sich. Klar, KI liefert beeindruckende Ergebnisse, aber das stärkste und unersetzbare Tool bleibt deine eigene Reflexion! Sprachmodelle wie ChatGPT bringen keine vollständige Ordnung in deine Gedanken, deshalb sollte der ausgegebene Content niemals 1 zu 1 übernommen werden, es sei denn du bist sehr sicher im Thema und kannst ihn adhoc verifizieren. Alle Ergebnisse sind, insbesondere bei Nischenwissen, stets zu prüfen, denn sie sind nur so gut wie die Trainingsdaten, mit denen die KI „gefüttert“ wurde. Und wissenschaftliches Wissen ist meistens Nischenwissen.

Summa summarum: Vor allem in der frühen Explorationsphase mit KI kommt wohl leider eher mehr Aufwand auf dich zu als weniger. Erst wenn du durchErfahrung eine realistische allgemeine Einschätzung der Ergebnisse erlangt und damit relative Sicherheit gewonnen hast, ist es sinnvoll, persönliche Routinen bei der Anwendung von KI zu internalisieren. Passiert dies zu früh, zu unreflektiert oder blind der KI vertrauend, ist anzunehmen, dass du dir automatisch kontraproduktive Arbeitsweisen aneignen und damit deine Kompetenzentwicklung untergraben wirst: A fool with a tool is still a fool (Abb. 3).

Das Gute: Du musst nicht technikaffin sein

Übrigens musst du nicht technikaffin sein, um Resultate zu erzielen, die sich sehen lassen können, du musst nur einen Plan haben. Es reicht, wenn du neugierig bist und dran bleibst, auch wenn es mal nicht sofort klappt: Gib dir und den Tools in der explorativen Phase Zeit und den nötigen Spielraum. Etwas Frustrationstoleranz kann auch nicht schaden – einfach ganz pragmatisch drangehen. Es gibt viele KIs dort draußen und jede funktioniert auf ihre Weise. Nicht wenige machen tatsächlich sehr viel Spaß und können sogar „süchtig“ machen, also vorsicht. So manche hat auch ihr ganz eigenes Bild von der Welt, wie du nicht nur bei Bildgeneratoren feststellen wirst. Da ChatGPT mit englischen Texten trainiert wurde, ist beispielsweise anzunehmen, dass ein eher westlich geprägter Blick auf die Welt die Grundlage für die durch die KI erzeugten Texte ist (Schulministerium NRW, 2023), während eine beispielsweise asiatisch oder afrikanisch geprägte KI ein ganz anderes Mindset haben dürfte.

Abb. 3: A fool with a tool is still a fool

Bildquelle: Wikipedia

Klar, KI liefert beeindruckende Ergebnisse, aber das stärkste und unersetzbare Tool ist deine Reflexion!

Wie „kreativ“ ist künstliche Intelligenz?

KI-Technologie könnte einen größeren Einfluss als Handys oder das Internet haben, was den Einfluss auf unsere Verarbeitung von Informationen angeht. Die Erhöhung von Effizienz oder Effektivität ist dabei aber längst nicht alles, was KI fördern kann. Ganz wesentlich ist auch der Kreativitätsschub, den KI individuell auszulösen definitiv in der Lage ist. Menschliche Kreativität ist allerdings etwas komplett anderes als die Art von Kreativität, von der in Bezug auf künstliche Intelligenz die Rede ist. In diesem Tab werden zur Orientierung drei spezifisch menschliche Fähigkeiten aufgelistet, die du von KI aktuell nicht zu erwarten brauchst. Ob Maschinen mit den aktuellen technologischen Ansätzen die nächste Stufe im Vergleich mit menschlicher Intelligenz bzw. Kreativität erklimmen können bzw. was mittelfristig zu erwarten sein könnte, ist eine unter Experten hitzig diskutierte und (geschäfts)geheimnisumwobene Frage:

Während Sam Altman einen guten Job für OpenAI macht, um Gelder für die Weiterentwicklung der Technologie in Richtung Allgemeine KI (AGI) zu akquirieren, folgt er damit letzlich der sogenannten Skalierungshypothese. Die Skalierungshypothese besagt, dass die Netze vor allem wachsen müssen, um intelligenter zu werden. Auf der anderen Seite gibt es Kritiker wie Erik Larson (2021), denenzufolge ein großer wissenschaftlicher Durchbruch nötig sei, um in den Bereich vorzudringen, der der menschlichen Intuition oder einem impliziten Weltwissen entspricht – welcher derzeit aber nicht absehbar sei. Futuristen seien sich sicher, dass eine menschenähnliche KI in Sicht ist, aber in Wirklichkeit hätten die Ingenieure keine Ahnung, wie man menschliches Denken programmiert. KI schlussfolgere aus statistischen Korrelationen zwischen Datensätzen, während menschlicher Verstand stark auf Vermutungen beruhe. Erik Larson vertritt die Ansicht, dass die Übertreibung bestehender Methoden uns nur von der Entwicklung einer wirklich menschenähnlichen KI abhält. Auch Bongartz und Merkert (2022) sehen die Grenze der Mensch-Maschine-Annäherung mit den gegenwärtigen technologischen Ansätzen bereits erreicht – mit den heutigen Methoden könne man sich ihr zwar asymptotisch nähern (sich ihr wie einer ins Unendliche verlaufenden Kurve nähern, ohne sie zu berühren), sie aber nicht überschreiten.

1. Eine KI kann keine menschliche Kommunikation mit uns führen

Du kannst, basierend auf dem Eliza-Effekt (siehe 1.1 Sprachmodelle: Nur stochastische Papageien?), über dein wirkliches Gegenüber leicht getäuscht werden. Entsprechend könntest du versuchen, eine menschliche Kommunikation mit dem Computer zu führen. KI-Assistenten müssen gar nicht viel tun, um in der menschlichen Wahrnehmung als eine wirklich soziale Interaktion zu erscheinen, simulieren diese aber nur. Sie funktionieren weit weniger komplex als menschliche Kommunikation. Zwar ist KI in der Lage, Emotionen zu erkennen und darauf zu reagieren, sie ist aber nicht selbst in der Lage, Emotionen auf die gleiche Weise zu verstehen und zu fühlen wie Menschen. Wenn man sie nicht so bedient, wie sie bedient werden sollten, funktionieren sie nicht.

2. Eine KI kann den Kontext nicht wie ein Mensch verstehen

Eine KI kann Schwierigkeiten haben, Ironie oder Sarkasmus zu erkennen. Ohne ein Verständnis für den Kontext könnte die KI fälschlicherweise eine ironische Aussage bzw. satirische Beiträge als wörtliche Wahrheit interpretieren. Ein Beispiel ist Google Overview, eine KI, die im Mai 24 Furore machte, weil sie Usern unter anderem empfahl, Kleber in die Sauce zu mischen, damit der Käse nicht von der Pizza rutscht. Wie im Blog Basic Thinking nachgelesen werden kann, schien es für Google auch Wochen später gar nicht so einfach, der KI zu vermitteln, dass diese Antwort in die Welt des Humors zu verorten ist – wohl auch dadurch, dass diese Information durch Nutzer*innen immer wieder eingespeist wird. Mit ChatGPT 4o erhalten KIs jetzt zwar auch die Möglichkeit, nonverbale Signale auszulesen, allerdings birgt dies auch das Risiko ungenauen Analysen oder falschen Schlussfolgerungen, insbesondere in Situationen, in denen subtile Nuancen wichtig sind oder die mehrere Ebenen der Bedeutung haben. In diesem zweiminütigen Video auf Deutsche Welle werden einige weitere Risiken angesprochen.

3. Eine KI kann (noch) nicht wie Menschen „Neues entwickeln“

Kreativität in Bezug auf KI wird häufig so definiert, dass – ob gezielt oder nicht – unkonventionelle Verbindungen von Wissensbestandteilen entstehen und mit ihnen gespielt wird. Wie du auf der Seite Prompt-Engineering: Wie sag ich’s meinem Bot? sehen wirst, kann dieser Zufalls-Charakter bei der Generierung der Outputs von ChatGPT mittels der sogenannten „Temperierung“ beeinflusst werden. Generell werden KIs oft ja ja eher als konservativ bezeichnet in dem Sinne, dass sie Gelerntes reproduzieren. Eine KI kann beispielsweise Texte, Bilder oder Musik generieren, jedoch fehlt ihr oft die emotionale Tiefe oder die künstlerische Vision. Menschen bringen ihre einzigartige Lebensgeschichte, ihre kulturellen Einflüsse und ihre individuellen Sichtweisen ein, die stark von persönlichen Erfahrungen, Überzeugungen und Perspektiven geprägt sind. All dies ist bislang schwer zu quantifizieren oder zu reproduzieren. Eine KI kann Werke basierend auf bestimmten Parametern oder Stilen erstellen, aber es fehlt zumeist an Originalität oder einer tieferen Bedeutung.

Vom Menschen hervorgebrachte Kunst verfolgt häufig einen Zweck, sei es die Reflexion über das Menschsein, die Suche nach Schönheit oder die Kommunikation komplexer Ideen. Menschen können in ihren kreativen Werken Bedeutungen und Botschaften vermitteln, die tiefergehende emotionale oder intellektuelle Einsichten bieten. Um auf geistigem, künstlerischem Gebiet – der eigenen Inspiration folgend – aus Impulsen Ideen zu entwickeln, braucht es diese Art von Sinnstiftung und Bedeutung. Menschliche Kreativität ist einerseits oft spontan und unvorhersehbar, andererseits können sich aus Impulsen über längere Zeit innovative Ideen entwickeln. Mit unvorhersehbaren Ansätzen, die über traditionelle Muster und Algorithmen hinausgehen, können Probleme gelöst werden, für die es aus der Vergangenheit noch keine Lösung gibt.

Eine weitere unbeantwortete Frage lautet also: Kann man einer KI beibringen, wie man ohne Anleitung im menschlichen Sinne kreativ wird? Kann sie es auch von alleine?